Les large language models (LLM) s’imposent comme une solution essentielle dans la transformation numérique des entreprises. En combinant performance, flexibilité et adaptabilité, ils ouvrent la voie à une révolution dans la gestion de tâches telles que la génération de texte, la traduction et la synthèse d’information. L’année 2024 a marqué la transition entre exploration et mise en production et 2025 s’annonce être celle de solutions scalables, robustes et maîtrisées.

Les entreprises doivent désormais faire des choix stratégiques entre des solutions open source auto-hébergées souveraines, des déploiements cloud ou le recours à une API propriétaire. Cet article analyse ces options en détail et propose des recommandations pour accompagner la transformation de manière adaptée aux enjeux de chaque structure.

Performance des LLM

La performance des LLM fait l’objet de nombreux benchmarks. Le plus répandu est le benchmark MMLU (Massive Multi Task Language Understanding). Ce test :

- Évalue plus de 57 critères dans des domaines variés, tels que les sciences sociales, la logique ou la physique.

- Attribue un score sur 100 aux modèles, offrant ainsi une vision détaillée de leurs capacités.

- Permet de mesurer la progression tant des modèles propriétaires que des modèles open source.

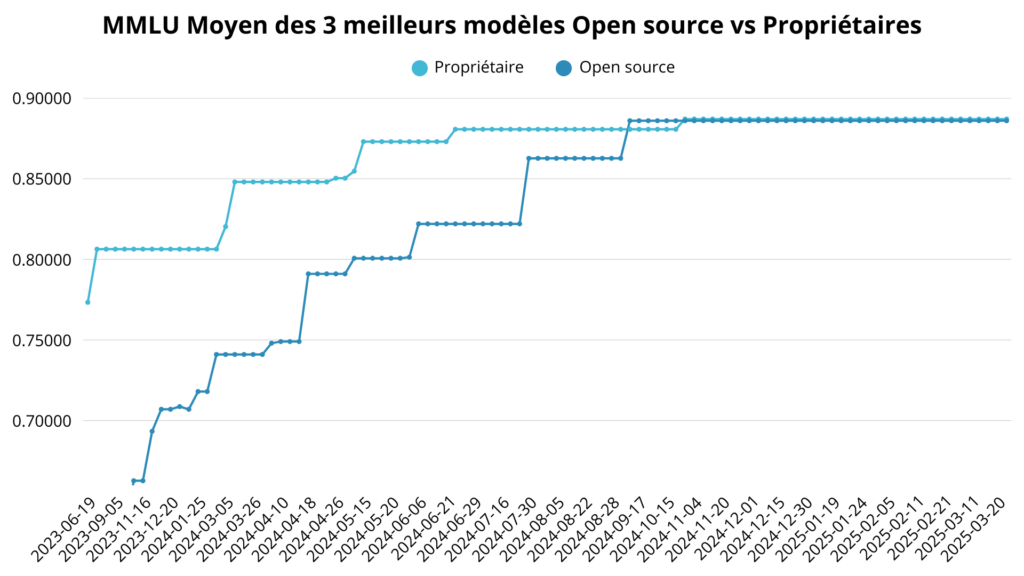

Selon les données collectées sur le site lmsys, on constate que l’écart de performance entre les modèles open source et propriétaires se réduit. En effet, on atteint désormais un plateau autour de 88%, comme en atteste ce graphique constitué depuis les données d’Huggingface du leaderboard lmsys :

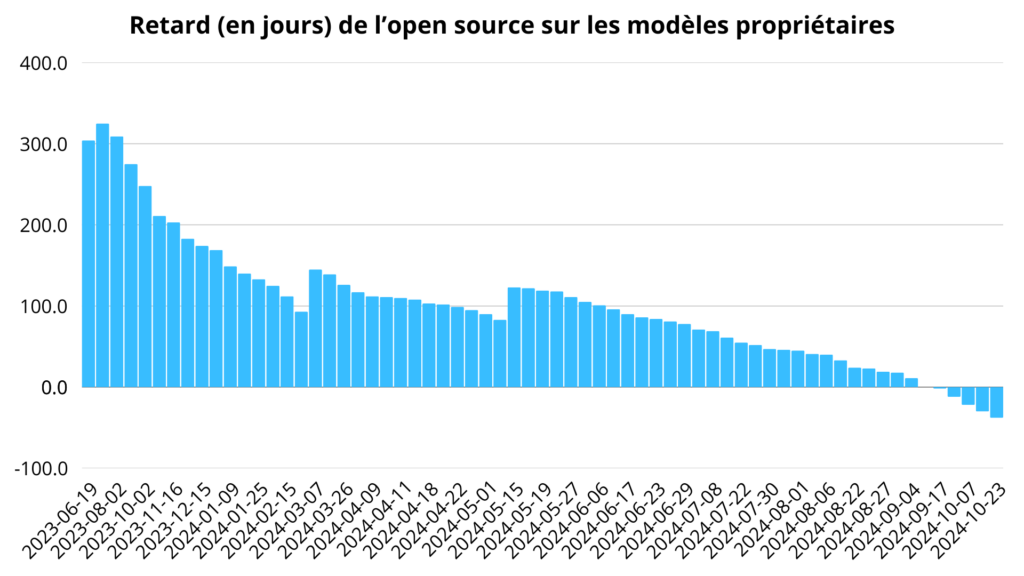

L’écart s’est complètement comblé en termes de performance, notamment avec la sortie de llama3.1 405b et Deepseek-v3. Ci-dessous l’écart en jours pour l’open-source d’atteindre les performances des modèles propriétaires :

La tendance actuelle démontre que :

- Les modèles open source gagnent en maturité

- Le retard par rapport aux solutions propriétaires diminue pour être inexistant aujourd’hui

- L’efficacité des technologies open source permet aux entreprises de considérer l’auto-hébergement comme une option sérieuse.

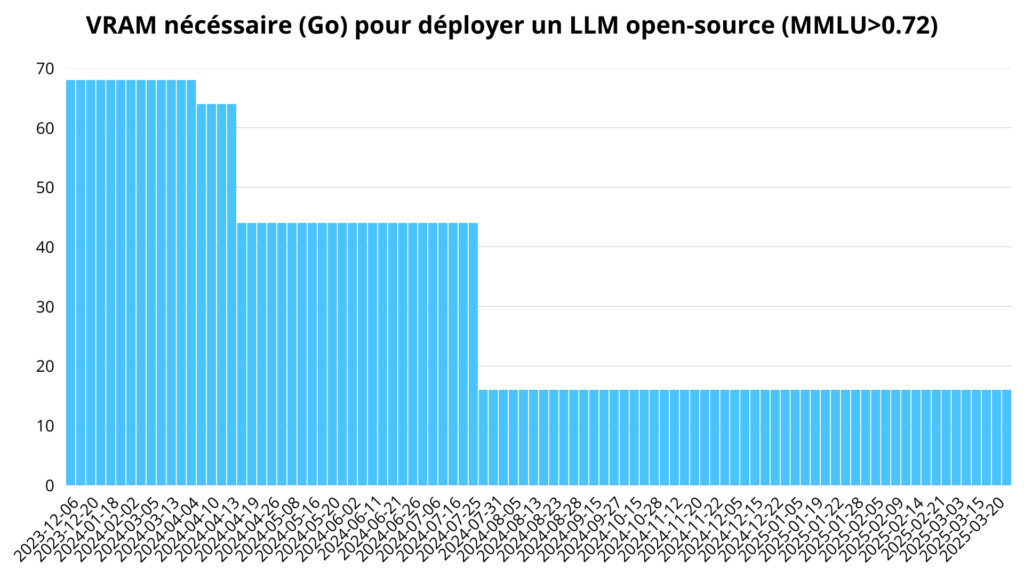

Accessibilité et Écosystème mûr

L’un des grands atouts des LLM open source est leur accessibilité. Contrairement aux solutions propriétaires, les LLM open source sont généralement mis à disposition gratuitement. Cette approche démocratise l’accès à l’innovation, permettant à toutes les entreprises, quelle que soit leur taille, de bénéficier de ces technologies de pointe.

De plus, avec l’optimisation faite par les développeurs et chercheurs, on arrive à avoir des LLM open-source avec d’excellentes performances qui restent peu coûteux à déployer sur ses propres infrastructures.

Points clés

- Coût d’accès réduit : Pas de frais d’abonnement onéreux.

- Possibilité de personnalisation : Adaptation des modèles aux besoins spécifiques.

- Écosystème riche : des outils et frameworks tels que Huggingface, vLLM, SkyPilot ou Ollama montrent que l’écosystème open source se consolide.

- Optimisation des performances : Les équipes techniques peuvent ajuster les modèles en fonction des contraintes matérielles comme la VRAM avec différentes techniques (quantization, fine tuning…).

Transparence et Sécurité

Les questions de transparence et de sécurité sont essentielles pour les entreprises. L’un des avantages notables des LLM open source est leur niveau élevé de transparence. Les poids du modèles étant accessibles, les entreprises bénéficient d’une meilleure compréhension du fonctionnement des modèles ainsi que d’une stabilité du comportement contrairement à une API ou le modèle sous-jacent peut changer, mettant en péril une pipeline construite dessus à n’importe quelle évolution du provider.

Avantages de la transparence

- Auditabilité: Permet aux équipes de vérifier le code et de détecter rapidement les failles.

- Réactivité de la communauté : Les mises à jour et correctifs sont déployés rapidement en cas de problème.

- Stabilité des comportement : pas de baisse de performances/ changement de comportement comme ça a pu être le cas sur l’api d’OpenAI il y a quelques mois

- Hébergement interne recommandé :

- Sécurité et souveraineté accrue en hébergeant les modèles sur ses serveurs internes

- Réduction significative du risque de fuite de données

Mise en pratique de l’usage éthique de la donnée au quotidien

Adopter un usage éthique de la donnée au sein de son entreprise, c’est aligner les valeurs de l’entreprise à l’usage des données, en déclinant ces principes de manière opérationnelle à tous les niveaux.

Personnalisation

La personnalisation est un critère fondamental pour adapter les solutions aux besoins spécifiques des entreprises. La force des modèles open source réside en grande partie dans leur flexibilité.

Les atouts de la personnalisation

Adaptabilité linguistique : Possibilité d’optimiser les modèles pour des langues et des contextes particuliers.

Fine-tuning : Les entreprises peuvent ajuster les modèles pré-entraînés en fonction de leur domaine d’activité.

Modules complémentaires : Ajout et intégration de nouvelles fonctionnalités pour répondre à des besoins spécifiques.

Comparaison des solutions de déploiement et coûts

Les entreprises sont souvent confrontées à trois options pour le déploiement des LLM : l’open source auto-hébergé, la solution cloud ou l’API propriétaire. Chaque option présente des avantages et des inconvénients en termes de coût, de contrôle et de flexibilité.

1. Open Source Auto-Hébergé

Avantages ✅

- Contrôle total : Personnalisation complète avec possibilité de fine-tuning.

- Sécurité renforcée : L’hébergement sur site permet de garder le contrôle sur les données.

Inconvénients ❌

- Investissement technologique : Nécessite une équipe technique compétente et du matériel (GPUs)

- Maintenance permanente : Les coûts liés à l’infrastructure, comme l’électricité et le matériel, doivent être pris en compte.

- Complexité de configuration : La mise en place initiale peut être longue et requérir des ajustements continus.

2. Solution Cloud

Avantages ✅

- Déploiement rapide : Les solutions sont souvent prêtes à l’emploi sans besoin d’infrastructure interne.

- Scalabilité : Les ressources peuvent être ajustées selon la demande croissante.

- Maintenance externalisée : Le fournisseur s’occupe des mises à jour et de la sécurité.

Inconvénients ❌

- Coûts récurrents : Les frais mensuels peuvent s’accumuler sur la durée.

- Dépendance au fournisseur : Les entreprises dépendent des politiques et de la disponibilité du prestataire.

3. API fermée (Closed Source API)

Avantages ✅

- Intégration facile : L’API s’intègre rapidement dans des environnements existants.

- Infrastructure gérée : Le fournisseur s’occupe de la gestion technique et des mises à jour.

- Accès à l’innovation : Les modèles propriétaires bénéficient de mises à jour régulières et d’un support continu.

Inconvénients ❌

- Coût par requête : L’usage intensif peut entraîner des coûts très élevés.

- Manque de contrôle : L’accès fermé au code source limite la personnalisation et l’auditabilité.

- Problèmes de confidentialité : Les données sensibles transitant par une API externe peuvent poser des questions de sécurité.

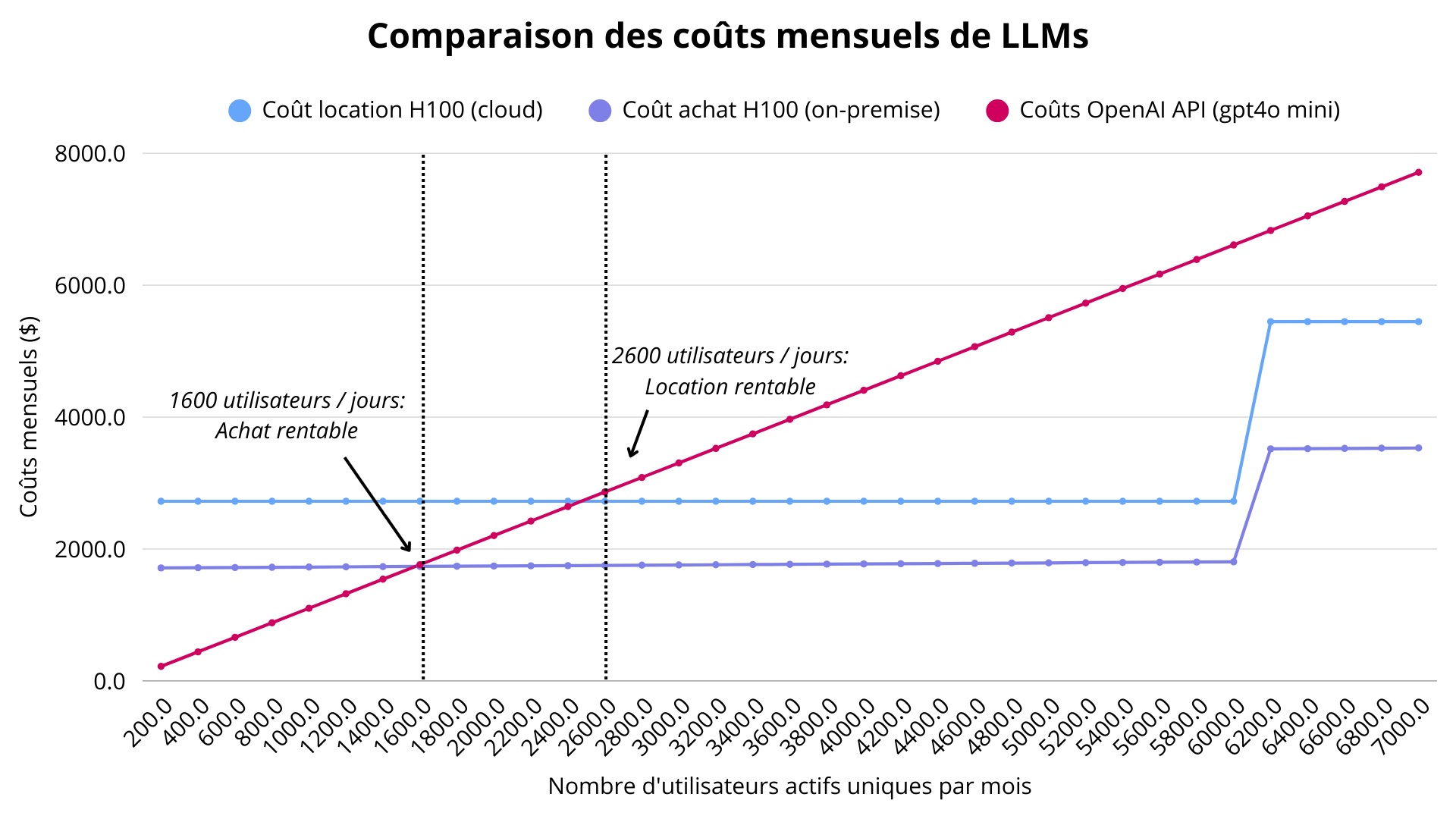

Nous avons effectué les benchmark entre les trois options dont voici les détails :

Open source auto hébergé: Mistral-small (v3) sur un Nvidia H100 (4000 tokens/s avec une latence acceptable): 30K $ la machine + coût d’électricité et serveur.

Open source Cloud: Mistral-small (v3) sur Nvidia H100 (~3$ / heure de location)

API fermée: OpenAI avec gpt-4o-mini (0,15$ / M de tokens en entrée, 0,6$ / M de tokens en sortie)

Ces deux modèles sont connus pour avoir un excellent rapport qualité prix et des performances similaires.

Les hypothèses de calculs sont inscrites dans la FAQ en bas de page.

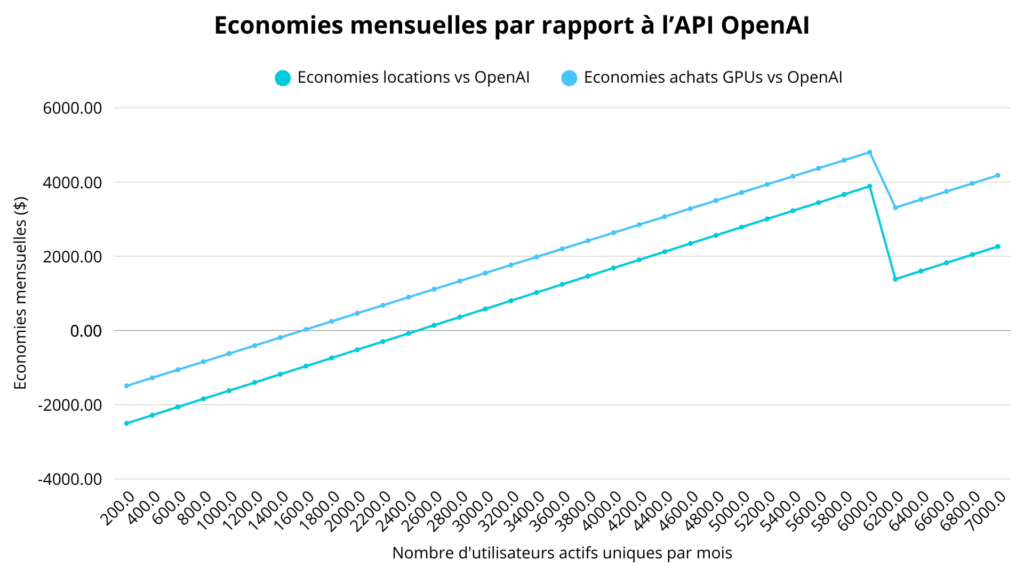

Voici la courbe finale de comparaison des prix en fonction du nombre d’utilisateurs uniques par jour :

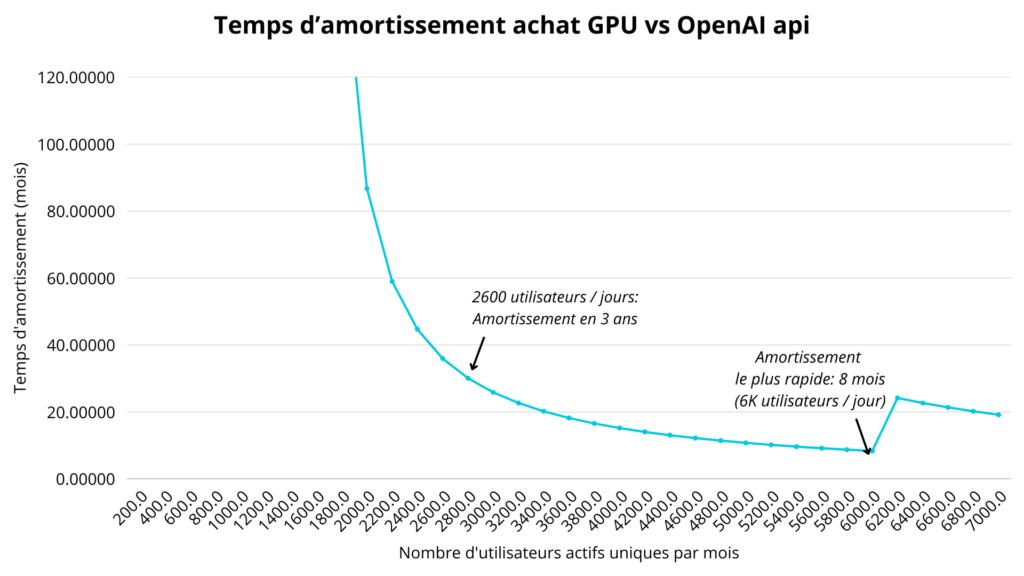

On observe un seuil de rentabilité des solutions cloud ou auto hébergés par rapport à l’api fermé openai à partir d’environ 2000 utilisateurs par jour et un amortissement de l’achat de machine sous 8 mois à 6K utilisateurs uniques par jour.

Quelle solution pour quelle entreprise ?

La décision sur la solution à adopter dépend de plusieurs facteurs essentiels. Chaque entreprise doit évaluer ses ressources, ses exigences de sécurité et ses objectifs stratégiques pour faire le choix le plus adapté.

PME et Startups en phase d’expérimentation

- Solution conseillée : API fermée

Raisons :

- Démarrage rapide sans nécessiter un investissement initial important.

- Possibilité de scaler facilement en fonction de la croissance

- Approche flexible idéale pour tester différents cas d’usage

Grandes entreprises et cas d’usage à forte intensité de calcul

- Solution à privilégier : API Fermée pour prouver la valeur sur des données non sensibles avec une perspective de transition vers du cloud voire de l’auto hébergé suivant les use cases

Raisons :

- Intégration rapide avec une gestion simplifiée de l’infrastructure.

- Accès aux dernières avancées technologiques tout en supportant une forte intensité de requêtes.

- Sur le long terme, les entreprises planifient souvent une transition vers une solution hybride ou auto-hébergée pour mieux maîtriser les coûts.

Conclusion

Les LLM open source illustrent parfaitement comment l’innovation technologique peut être accessible à toutes les entreprises, qu’elles soient de grande envergure ou en phase de démarrage. Ces modèles offrent des avantages indéniables en termes de performance, transparence, et personnalisation. En même temps, la comparaison avec les solutions cloud et les API propriétaires met en lumière des critères essentiels comme le coût, la sécurité et le niveau de contrôle.

Pour résumer :

- Open Source Auto-Hébergé :

- Idéal pour les entreprises disposant d’une infrastructure et d’une équipe technique compétente

- Permet une personnalisation poussée et un contrôle total sur les données.

- Solution Cloud :

- Adaptée aux PME et startups qui souhaitent déployer rapidement la technologie.

- Offre une bonne souplesse et une mise en place rapide sans investissement initial lourd

- API fermée :

- Convient aux grandes entreprises sur des données non sensibles et aux startups aux projets nécessitant une intégration immédiate.

- Présente cependant un coût à long terme à mesure du scale qui peut devenir conséquent.

Chaque entreprise doit ainsi choisir la solution la mieux adaptée à ses besoins. La transition vers l’auto-hébergement ou l’adoption d’un modèle hybride peut constituer une voie judicieuse à mesure que les exigences en termes de sécurité et de personnalisation s’intensifient.

En définitive, le choix entre une solution open source auto-hébergée, un déploiement cloud ou une API propriétaire repose sur des critères stratégiques précis. L’analyse des coûts, le niveau de contrôle souhaité, la capacité technique ainsi que les objectifs à court et long terme doivent orienter la décision. Les entreprises qui intègrent ces technologies de manière réfléchie tirent parti d’un avantage concurrentiel majeur dans un environnement de plus en plus digitalisé et compétitif.

FAQ : Questions fréquentes

Qu’est-ce qu’un LLM open source ?

Un LLM open source est un modèle de langage dont les poids sont accessibles gratuitement. Cela permet à toute entreprise ou développeur de modifier, personnaliser et déployer le modèle en fonction de ses besoins spécifiques.

Quels sont les principaux avantages de l’open source auto-hébergé ?

Les avantages incluent :

– Coût initial réduit

– Contrôle total et personnalisation poussée

– Sécurité renforcée grâce à l’hébergement interne

– Transparence du code source

Qu’est-ce qui distingue une solution cloud d’une solution open source auto-hébergée ?

La solution cloud se caractérise par :

– Une mise en place rapide et simple

– Une gestion de l’infrastructure externalisée

– Une scalabilité facile

Cependant, elle peut engendrer des coûts récurrents élevés et offre moins d’options de personnalisation.

Pourquoi certaines entreprises choisissent-elles une API propriétaire ?

Les entreprises optent pour une API propriétaire lorsqu’elles recherchent :

– Une intégration rapide dans des systèmes existants

– Une gestion technique simplifiée

– L’accès aux dernières mises à jour et innovations technologiques

Toutefois, elles acceptent un coût par requête plus élevé et une transparence limitée du code.

Comment l’évolution des performances des modèles open source influence-t-elle leur adoption ?

L’amélioration continue des performances, attestée par des benchmarks tels que MMLU, renforce l’adoption des modèles open source. On constate une réduction de l’écart de performance avec les solutions propriétaires, ce qui rend les options open source de plus en plus attractives pour une utilisation en production.

Quelles sont les hypothèses du calcul des prix de chaque option ?

Open source cloud: Mistral small v3 déployé avec vLLM sur une instance Nvidia H100 (~3$ de l’heure en location). On obtient 4000 tokens / s sous 300 requêtes concurrentes avec une latence de moins d’une seconde.

Open source auto hébergé: Mistral small v3 déployé avec vLLM sur un Nvidia H100 (30K $) et un serveur à 10K $ pour le faire tourner. Coût d’électricité: 18 centimes le kwh.

1 utilisateur unique = 3 sessions de 10 min par jour en moyenne.

On en discute !